您现在的位置是:首页 >财经 > 2020-11-09 09:09:23 来源:

使用AI检测看似完美的深层视频

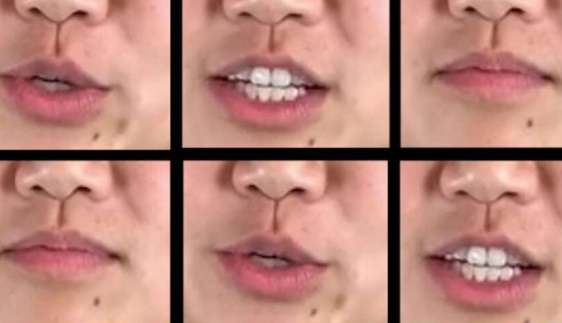

一年前,斯坦福大学的Maneesh Agrawala帮助开发了口型同步技术,该技术使视频编辑人员几乎无法察觉地修改说话者的单词。该工具可以无缝地插入一个人从未说过的单词,甚至是句子中间,也可以消除她曾经说过的单词。在肉眼上,甚至对许多基于计算机的系统,看起来都没有错。

使用该工具可以更轻松地修复故障,而无需重新拍摄整个场景,以及为不同地方的不同观众量身定制电视节目或电影。

但是,这项技术还为难以发现的深造视频创造了令人担忧的新机会,这些深造视频的创建是为了歪曲事实。一个最近的共和党的视频,例如,使用较粗略的技术,医生与副总统拜登的采访。

今年夏天,斯坦福大学和加州大学伯克利分校的Agrawala及其同事推出了一种基于AI的方法来检测口形同步技术。通过识别人们发出的声音与嘴巴形状之间的微小不匹配,新程序可以准确发现80%以上的假货。

但是斯坦福大学布朗媒体创新研究所所长,森林篮科学计算机科学教授,也隶属于斯坦福大学以人类为中心的人工智能研究所的阿格拉瓦拉警告说,对于深层假货没有长期的技术解决方案。

他说,真正的任务是提高媒体素养,使人们在故意制造和传播错误信息时承担更多责任。

他说:“随着操纵视频的技术越来越好,探测操纵技术的能力将越来越差。” “我们需要专注于非技术方法,以识别和减少虚假信息和虚假信息。”

例如,拜登操纵的录像不是通过技术曝光的,而是因为采访副总统的人意识到他自己的问题已经改变。

深度假货的工作原理

操纵视频是有正当理由的。例如,制作虚构电视节目,电影或商业广告的任何人都可以使用数字工具清理错误或调整脚本来节省时间和金钱。

问题是当有意使用这些工具传播虚假信息时出现的。并且许多技术对于普通观众是不可见的。

许多假冒的视频都依赖于换脸,实际上是将一个人的脸叠加到另一个人的视频上。但是,尽管换脸工具令人信服,但它们相对粗糙,通常会留下计算机可以检测到的数字或视觉伪像。

另一方面,口型同步技术则比较细微,因此很难发现。他们操纵图像的一小部分,然后合成与一个人的嘴巴真正吻合的嘴唇移动方式(如果他或她说了某些特定的单词)。Agrawala说,只要有足够的人的图像和声音样本,虚假的制作人就可以使人“说”任何话。