您现在的位置是:首页 >互联网 > 2020-11-06 14:02:07 来源:

Nvidia首次推出云服务器平台以统一AI和高性能计算

为了保持在人工智能和高性能计算领域的领先地位,英伟达公司(Nvidia Corp.)周二晚推出了一种新的计算架构,该架构声称将统一该行业的两个快速增长领域。

Nvidia首席执行官黄仁勋在台湾台北举行的GPU技术会议上宣布了HGX-2 云服务器平台的发布,该发布旨在针对结合了AI和HPC的许多新应用。

Nvidia加速计算部门产品营销经理Paresh Kharya在星期二的新闻发布会上说:“我们相信,未来需要AI和高性能计算的统一平台。”

其他人也同意。Moor Insights&Strategy的高级分析师Karl Freund告诉SiliconANGLE:“我认为AI将彻底改变HPC。” “我怀疑许多超级计算中心将部署HGX2,因为它可以为HPC和AI都增加惊人的计算能力。”

更具体地说,新架构支持涉及科学计算和模拟的应用程序,例如天气预报,以及AI模型(例如深度学习神经网络)的训练和运行,用于图像和语音识别以及自动驾驶导航等工作。汽车。Kharya说:“这些模型正在以前所未有的速度进行更新,”有时每小时更新一次。

该HGX架构,搭载Nvidia的图形处理单元,或GPU,是微软公司的使用的数据中心设计项目奥林巴斯举措,Facebook公司的大盆地系统和Nvidia自己DGX-1超级计算机AI以及服务由公共云计算领导者Amazon Web Services Inc.提供。该架构的第一版HGX-1于一年前发布。

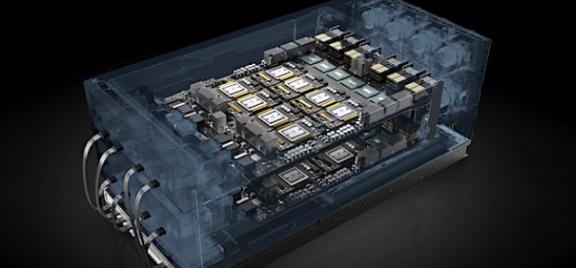

本质上,HGX-2由Nvidia的16个高端V100 GPU组成,为计算机制造商提供了创建该系统的基础。该公司表示,利用Nvidia的NVLink互连系统,它使16个GPU看起来像一个GPU,每秒可提供2 petaflop或2 quadrillion浮点运算,这是标准的计算速度度量。

“基本上,您现在可以将HGX用作16个GPU的池,就好像它是一个非常大的计算资源一样,” Freund解释说。

Nvidia今天还表示,其自己最近宣布的DGX-2 AI超级计算机是首个使用HGX-2的系统。它将在第三季度上市时售价为399,000美元。Huang在他的会议主题演讲的现场直播中开玩笑说这是“巨大的价值”,尽管他似乎也很在意。

英伟达已经创建了三类服务器,它们以最佳配置混合了中央处理器和GPU,以进行AI训练,AI推理或模型运行以及超级计算。

Kharya试图将HGX架构定位为类似于英特尔和微软开发的ATX个人计算机主板配置标准,这导致许多公司制造的兼容系统组件激增。

服务器制造商联想集团有限公司,广达云技术公司或QTC,Super Micro Computer Inc.和Wiwynn Corp.在周二宣布计划建造HGX-2系统的公司中,还有所谓的原始设计制造商鸿海精密工业有限公司。该公司的系统被世界上一些最大的云数据中心所使用,该公司(称为富士康),英业达公司,广达计算机公司和纬创资通表示,它们将于今年晚些时候交付HGX-2系统。

同时,英特尔正在加紧努力扩大其在人工智能计算领域的地位,最近一次是在上周预览了一种新,该制造商表示该旨在更快地构建AI模型,该将于2019年底发布。英特尔AI部门负责人Naveen Rao向Nvidia开枪,称其GPU比英特尔最新的Xeon中央处理单元快得多的说法是“神话”。