您现在的位置是:首页 >综合 > 2020-12-02 08:53:37 来源:

即使是来自机器人的垃圾谈话也很伤人

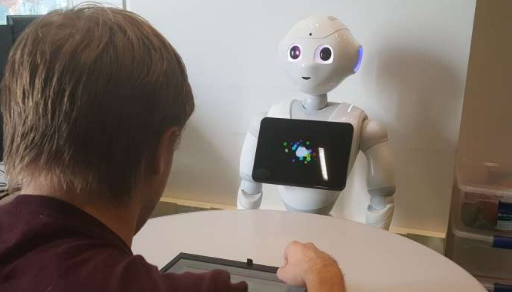

乱说垃圾话语长期困扰着游戏对手,现在,卡内基梅隆大学的研究人员已经证明,令人沮丧的单词即使被机器人说出来也会受到干扰。该研究中的垃圾言论绝对是温和的,诸如“我必须说你是一个糟糕的球员”和“在比赛过程中,你的比赛变得混乱”之类的话。即便如此,使用机器人玩游戏的人(一种市售的人形机器人,称为Pepper)在劝阻他们时表现较差,而在鼓励他们时则表现更好。

主要作者亚伦·罗斯(Aaron M. Roth)说,参加研究的40名参与者中有一些技术上很熟练,并且完全理解机器是造成不适的原因。

罗斯说:“一位参与者说,'我不喜欢机器人在说什么,但这是它被编程的方式,所以我不能怪它。'机器人学院。

但是研究人员发现,总体而言,无论技术水平如何,人类的表现都会减弱。

这项研究于上个月在印度新德里举行的IEEE国际机器人与人机交互通信国际会议(RO-MAN)上提出,它偏离了典型的人机交互研究,后者着重于研究人类和机器人如何做到最佳。一起工作。

“这是在不合作的环境中进行人机交互的首批研究之一,”合著者,软件研究所副教授费芳说。它有一个地方的机器人数量和世界产生巨大影响的物联网(IOT)具有人工智能功能的设备预计将成倍增长。她说:“我们可以期望家庭助理能够合作,但是在诸如在线购物之类的情况下,他们的目标可能与我们的目标不同。”

这项研究是方方正教授的“社会方法AI方法”中一个学生项目的产物。这些学生想探索机器人理论中博弈论和有限理性的用途,因此他们设计了一项研究,人类将在名为“守卫与宝藏”的游戏中与机器人竞争。研究人员使用所谓的Stackelberg游戏来研究理性。这是一个典型的游戏,用于在安全游戏的研究中研究防御者与攻击者的互动,Fang在该领域进行了大量工作。

每个参与者都在机器人上玩了35次游戏,既可以听从机器人的鼓励性话,也可以用不屑一顾的话让他们的耳朵歌唱。尽管随着玩游戏次数的增加,人类玩家的合理性有所提高,但受到机器人批评的人得分却不及受到赞扬的人。