您现在的位置是:首页 >动态 > 2020-11-19 17:25:26 来源:

受量子启发的视频情感分析框架

自动识别以视频或文字表达的整体情绪可能对广泛的应用很有用。例如,它可以帮助公司或政党筛选大量在线内容,并了解公众对他们的产品,服务,活动或计划的看法。

帕多瓦大学,开放大学和哥本哈根大学的研究人员最近推出了一种基于量子物理学理论的视频情感分析新框架。这个框架在Elsevier的Information Fusion杂志上发表的一篇论文中提出,融合了不同类型的视频功能并分析了它们之间的复杂交互。

该研究人员小组进行的研究是QUARTZ(量子信息访问和检索理论)项目的一部分,该项目是由欧盟的MarieSkłodowskaCurie Actions计划资助的一项更广泛的研究工作。QUARTZ项目的主要目的是探索量子力学在设计有效信息检索系统(例如Web搜索引擎)中的潜在用途。

“作为QUARTZ项目的一部分,我们一直在解决许多问题,从纯粹的理论问题到实验研究,”进行这项研究的研究人员之一Qiuchi Li告诉TechXplore。“我们最近的研究扎根于这两个领域,因为它考虑了代表多模式信息的基本问题,并通过科学实验检验了所提出方法的有效性。”

在过去的十年左右的时间里,发现量子理论框架在解释人类认知的某些方面比经典的概率论理论具有许多优势。尽管具有这些优点,但到目前为止,研究人员仅开发了一些有效的量子启发模型,这些模型可以在认知任务上实现人类的表现。

Li和他的同事在研究中着手开发一种量子启发模型,该模型在情感分析任务上表现良好,通常由人类完成。他们的总体目标是确定这样一个框架是否可以实现人类可比的性能。

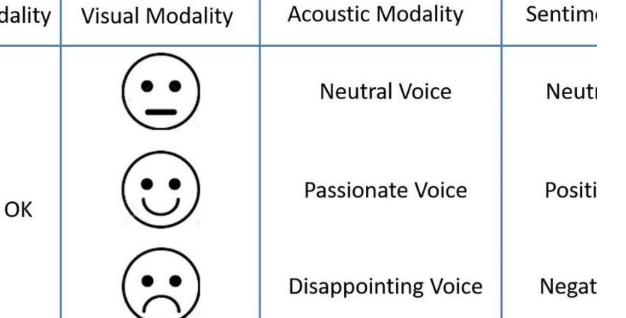

“我们以前为基于文本的情感分析建立了模型,但是本文着重于多峰环境中的情感分析,并提出了一种量子驱动方法来解决多峰融合的关键任务,”李解释说。“就像其他多模态情感分析系统一样,提出的模型接受话语的多模态特征,并预测其情感作为输出。”

李和他的同事开发的框架基于许多功能来分析视频,包括文本,视觉和听觉元素。与依靠人工神经网络(ANN)的传统最新模型相反,新框架从与量子物理学理论相一致的角度分析视频内容。